Theo thông tin từ The Information, Google hiện đang đàm phán với Marvell Technology để cùng phát triển hai dòng chip mới phục vụ cho các hệ thống trí tuệ nhân tạo.

Các nguồn tin cho biết dự án này tập trung vào việc giải quyết những điểm nghẽn lớn nhất trong vận hành AI hiện nay, đặc biệt là vấn đề bộ nhớ và hiệu năng suy luận.

Trong đó, chip đầu tiên được nhắc đến là một bộ xử lý bộ nhớ chuyên dụng, hay còn gọi là MPU. Khác với cách tiếp cận truyền thống khi mọi tác vụ đều được xử lý trên cùng một con chip, MPU sẽ hoạt động song song với TPU, dòng chip AI chủ lực của Google.

Vai trò chính của MPU là đảm nhận riêng phần xử lý bộ nhớ, giúp giảm tải cho TPU và tăng tốc độ truy xuất dữ liệu khi vận hành các mô hình AI quy mô lớn.

Chip thứ hai là một thế hệ TPU hoàn toàn mới, được thiết kế với trọng tâm là tối ưu hóa cho tác vụ suy luận. Đây là giai đoạn mà mô hình AI đã hoàn tất huấn luyện và bắt đầu xử lý các yêu cầu thực tế từ người dùng.

Trên thực tế, suy luận đang trở thành phần tiêu tốn nhiều tài nguyên nhất trong toàn bộ vòng đời của một hệ thống AI, đồng thời cũng là điểm nghẽn lớn nhất khi triển khai ở quy mô hàng triệu người dùng.

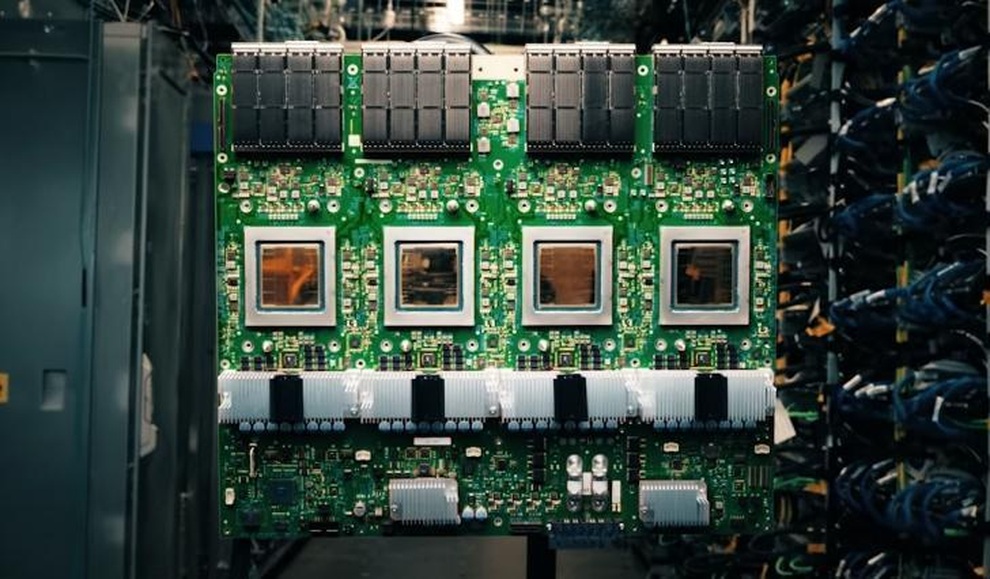

Hiện tại, nền tảng phần cứng AI của Google đang dựa trên dòng TPU v7 Ironwood, một trong những thế hệ chip mạnh nhất mà hãng từng phát triển. Mỗi chip Ironwood được trang bị bộ nhớ HBM dung lượng lên tới 192 GB, đáp ứng nhu cầu xử lý dữ liệu khổng lồ của các mô hình AI hiện đại.

Trong các cụm máy chủ quy mô lớn, Google có thể kết nối tới 9.216 chip này trong một hệ thống mà hãng gọi là Superpod, tạo nên năng lực tính toán cực kỳ mạnh mẽ.

Tuy nhiên, nhu cầu sử dụng Ironwood đang tăng nhanh trong khi nguồn cung chip bán dẫn toàn cầu vẫn trong tình trạng căng thẳng. Đây cũng là một trong những lý do khiến Google phải tìm hướng đi mới, thay vì chỉ tiếp tục mở rộng quy mô với kiến trúc hiện tại.

Chiến lược phát triển MPU cho thấy Google đang đi theo xu hướng chung của ngành công nghiệp bán dẫn, đó là sử dụng các chip phụ trợ chuyên biệt để tối ưu từng khâu trong hệ thống. Cách tiếp cận này có điểm tương đồng với hướng đi của NVIDIA, khi hãng này phát triển các bộ xử lý chuyên dụng nhằm giảm tải cho GPU chính và nâng cao hiệu quả tổng thể.

Việc kết hợp giữa TPU thế hệ mới và chip MPU được kỳ vọng sẽ tạo ra bước nhảy vọt về hiệu năng, đặc biệt trong giai đoạn suy luận. Đây là yếu tố then chốt khi các dịch vụ AI ngày càng được triển khai rộng rãi, phục vụ đồng thời hàng triệu người dùng trên toàn cầu.